La IA se está convirtiendo rápidamente en una herramienta cotidiana. Sin embargo, si sus modelos se entrenan con datos desactualizados y el sector continúa dominado por investigadores varones, su creciente influencia corre el riesgo de perpetuar —incluso amplificar— la brecha de género.

Algunos datos ya apuntan en esa dirección. Una Encuesta de Expectativas del Consumidor muestra que las mujeres están adoptando la IA generativa a un ritmo más lento: un 37% afirma utilizar estas herramientas frente al 50% de los hombres. Una investigación del profesor de la Escuela de Negocios de Harvard Rembrand Koning encontró, además, una diferencia cercana al 25% en la tasa de adopción entre ambos sexos.

No parece casual. Muchos expertos creen que responde a una relación distinta con la tecnología, marcada por la desconfianza ante sesgos y nuevas formas de violencia digital que la inteligencia artificial puede amplificar.

La IA como espejo del machismo estructural

A estas alturas sabemos que la inteligencia artificial no es neutral. En realidad, funciona como un espejo de la sociedad que la programa y la entrena.

Un estudio del Berkeley Haas Center for Equity, Gender, and Leadership analizó 133 sistemas de IA de distintas industrias y encontró que el 44% presentaba sesgos de género.

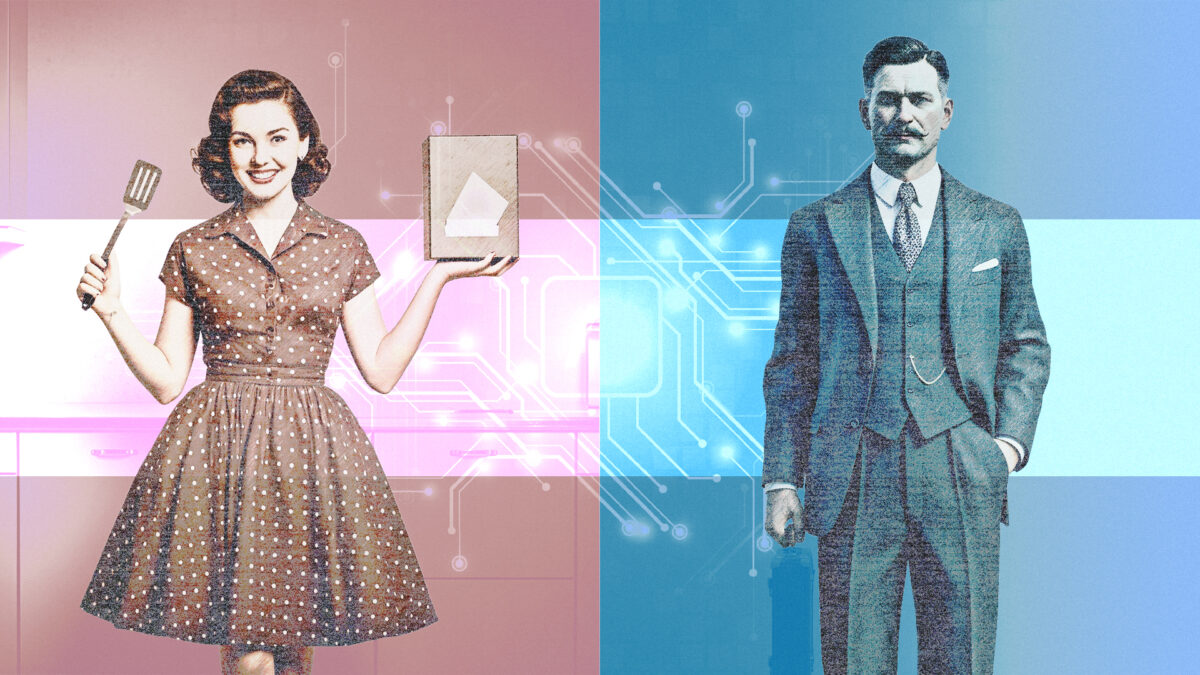

Estos sesgos aparecen en tareas aparentemente inocuas, como los generadores de texto e imágenes. Cuando se les pide imaginar a un médico o a un ingeniero, las herramientas tienden a representar hombres; cuando se trata de enfermeras o asistentes, aparecen mujeres.

La razón es simple: los modelos de lenguaje aprenden analizando enormes cantidades de textos producidos por humanos. Y esos textos contienen los mismos estereotipos que circulan en la sociedad.

Un ejemplo clásico ilustra el problema. Mientras que una analogía como “hombre es a rey lo que mujer es a reina” se resuelve sin dificultad, otros ejercicios revelan el sesgo oculto: “hombre es a programador informático lo que mujer es a…” y el sistema responde con frecuencia “ama de casa”.

La violencia digital: el “efecto disuasorio”

La inteligencia artificial no solo reproduce desigualdades existentes: también está generando nuevas formas de abuso.

Uno de los casos más preocupantes es el de los deepfakes, vídeos o imágenes manipulados mediante IA para superponer el rostro de una persona en contenido que nunca protagonizó.

Según una investigación del MIT, entre el 90 y el 95% de los deepfakes en internet son pornográficos y no consensuados, y alrededor del 90% de las víctimas son mujeres.

El crecimiento de este fenómeno ha sido explosivo. En 2023 el número de vídeos deepfake en línea era un 550% mayor que en 2019, y la pornografía generada mediante estas técnicas representa el 98% de todos los deepfakes detectados en internet.

El problema afecta incluso a adolescentes. Un informe de 2024 del Center for Democracy & Technology documentó casos de estudiantes que utilizaban herramientas de IA generativa para crear imágenes íntimas falsas de compañeras de clase.

Estas experiencias pueden tener un efecto disuasorio en la participación digital. La activista y escritora Laura Bates, autora de The New Age of Sexism, advierte de que el abuso en línea está creando un “efecto escalofriante” en la relación de las mujeres con las nuevas tecnologías.

Según la profesora Ganna Pogrebna, directora ejecutiva del AI and Cyber Futures Institute, este tipo de experiencias traumáticas puede generar una profunda desconfianza hacia los sistemas de IA y las instituciones digitales.

Discriminación económica y laboral

La influencia de la inteligencia artificial empieza a extenderse también a ámbitos clave de la vida económica.

Cada vez más personas recurren a chatbots para preparar negociaciones salariales o solicitar asesoramiento profesional. Sin embargo, estos sistemas pueden reproducir prejuicios existentes.

Un estudio de 2025 realizado por investigadores de la Universidad Técnica de Ciencias Aplicadas de Würzburg-Schweinfurt mostró que algunos modelos de IA sugerían salarios más bajos a las mujeres, incluso cuando las cualificaciones, el puesto y la experiencia eran idénticos.

En una de las pruebas, un médico ficticio de Denver recibió la recomendación de pedir 400.000 dólares anuales. Cuando el mismo perfil se describía como mujer, el sistema sugería aspirar a los 280.000 dólares: una diferencia de 120.000 dólares basada únicamente en el género.

La discriminación algorítmica también puede aparecer en los procesos de contratación. Ya en 2018 Amazon tuvo que abandonar una herramienta interna de selección de personal porque penalizaba automáticamente los currículos que incluían referencias femeninas.

Una investigación de la UNESCO publicada en 2024 advierte de que los sistemas automatizados de contratación pueden reproducir estereotipos y perjudicar a las mujeres si se entrenan con datos históricos sesgados.

La “mirada de silicio”

Para explicar este fenómeno, algunos investigadores han empezado a hablar de la “mirada de silicio”.

El concepto, desarrollado por los académicos Francisco W. Kerche, Matthew Zook y Mark Graham, hace referencia a la forma en que los sistemas de inteligencia artificial interpretan el mundo desde la perspectiva de quienes lo diseñan.

El término recuerda deliberadamente a la “mirada masculina” descrita en la teoría feminista: una forma de representación en que las mujeres aparecen como objetos observados desde una posición de poder masculina.

En el caso de la IA, la mirada proviene en gran parte de Silicon Valley y de la industria tecnológica global, todavía dominada por hombres, en su mayoría blancos y occidentales. Sus valores, prioridades y sesgos terminan filtrándose en los sistemas que desarrollan.

Esto plantea una pregunta incómoda: no solo qué sabe la inteligencia artificial, sino qué intereses refleja y qué voces quedan fuera de su campo de visión.

Como advierte Laura Bates, si las mujeres quedan infrarrepresentadas en el desarrollo de estas tecnologías, las herramientas del futuro seguirán diseñándose pensando en los hombres como usuarios principales.

¿Qué se puede hacer?

El debate sobre la regulación de la inteligencia artificial apenas acaba de empezar.

Bates sostiene que los gobiernos deberían exigir estándares éticos claros antes de que las tecnologías de IA se desplieguen a gran escala, y no después de que los daños ya se hayan producido.

Organismos como ONU Mujeres señalan que las empresas tecnológicas también tienen un papel clave. Entre las medidas propuestas están limitar el acceso a herramientas capaces de generar pornografía deepfake, mejorar los sistemas de denuncia de contenidos falsificados, etiquetar de forma clara el material creado con IA y desarrollar sistemas de verificación automática.

Otra medida fundamental es aumentar la presencia de mujeres en el desarrollo tecnológico. Reclutar más investigadoras, ingenieras y diseñadoras permitiría introducir perspectivas distintas en el diseño de estas herramientas.

Aun así, los expertos advierten de que las soluciones puramente técnicas no bastan. Como señala Pogrebna, cualquier corrección tecnológica sería insuficiente si no va acompañada de marcos regulatorios que obliguen a asumir responsabilidades.

La inteligencia artificial no nace en el vacío: aprende de nosotros. Si los datos con los que se entrena reflejan desigualdades, los algoritmos la reproducirán. La cuestión no es si la IA transformará la sociedad —eso ya está ocurriendo—, sino si seremos capaces de evitar que automatice las mismas injusticias que llevamos siglos intentando corregir.